正文内容

网站: https://lmarena.ai/

开发者: LMSYS Org (UC Berkeley SkyLab、Stanford 等学术机构联合团队)

成立时间: 2023年

性质: 开源众包 AI 评测平台

数据规模: 600万+ 人类投票,覆盖 190+ 个模型

LMSYS 摘要

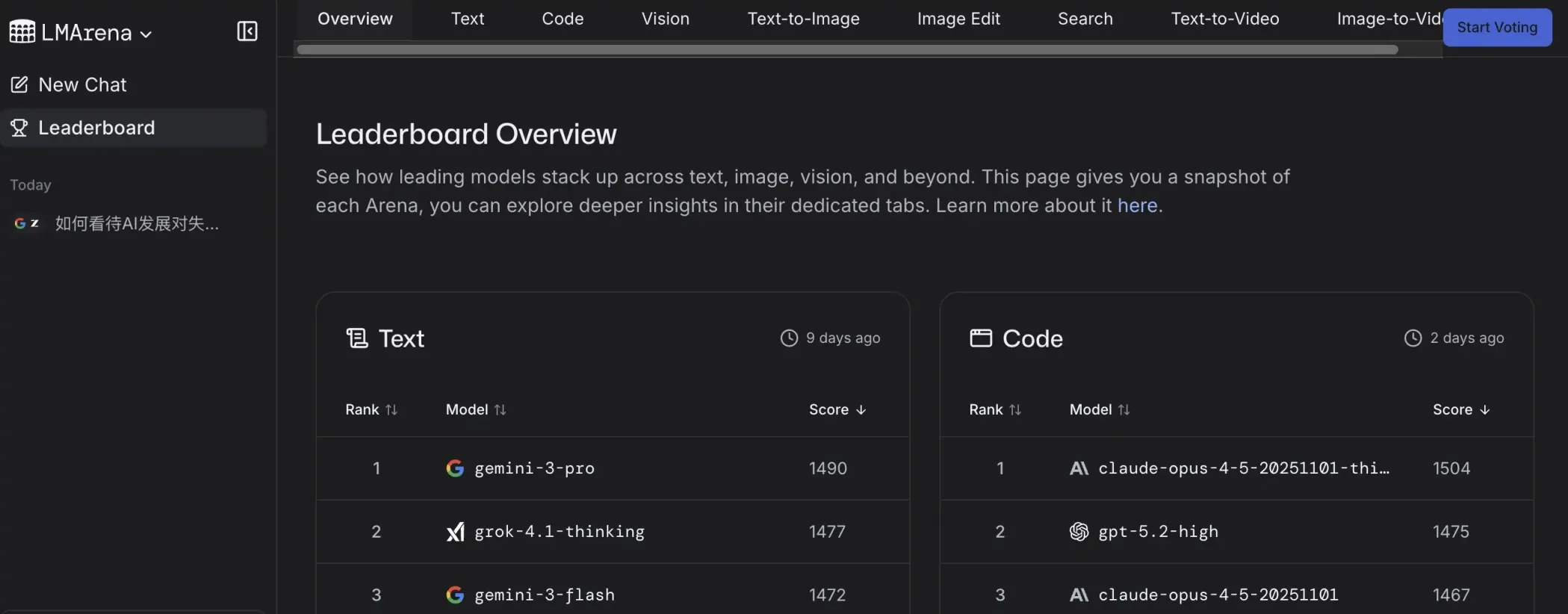

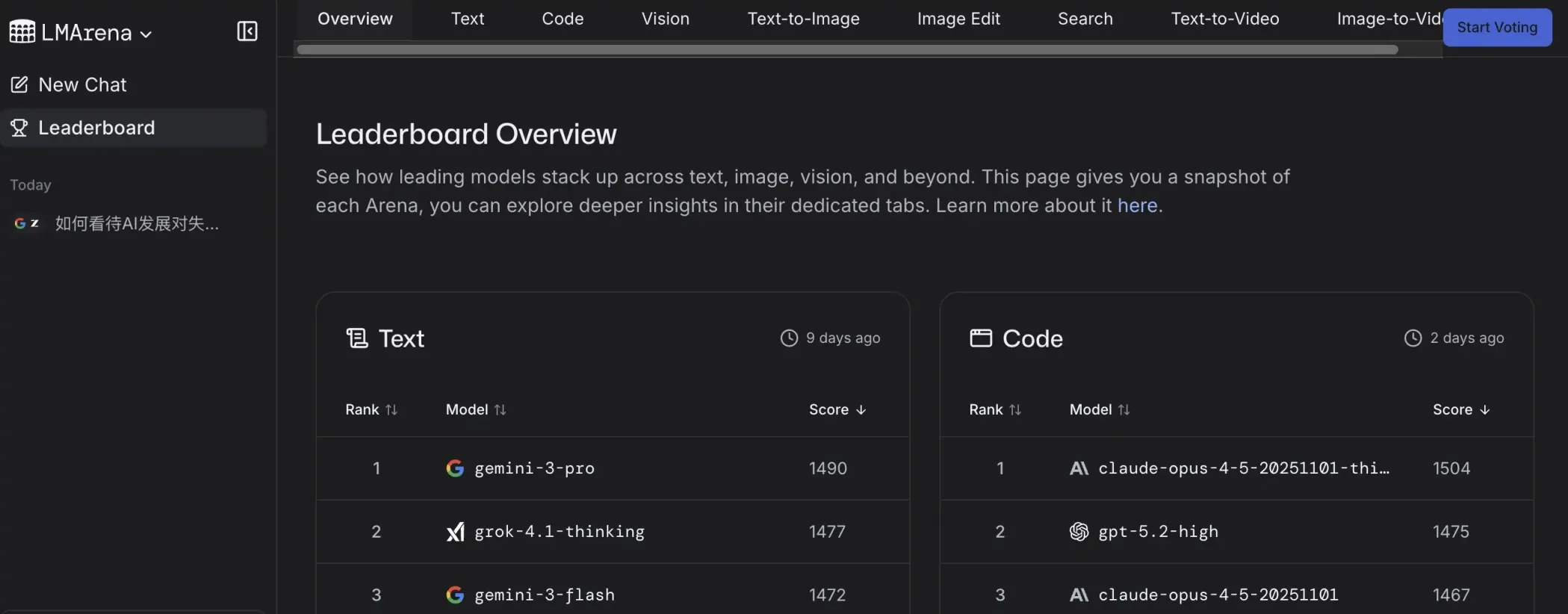

LMSYS Chatbot Arena 是一个开放的众包平台,通过匿名双盲对战让真实用户评估大语言模型。用户同时与两个随机匿名模型对话并投票,平台基于 Bradley-Terry 统计模型和 Elo 评分系统生成实时排行榜。目前已收集超 600 万张投票,涵盖 GPT-4、Claude、Gemini、DeepSeek、Qwen 等 190+ 模型,并细分为数学、编程、指令遵循等多维度,是 AI 领域最具影响力的第三方评测基准之一。

LMSYS 核心机制

🥊 匿名双盲对战(Blind Battle)

用户输入同一提示词,同时获得两个随机匿名模型的回复 根据回答质量投票(A更好、B更好、平手、两者都差) 消除品牌偏见,完全基于内容质量评判

📊 Bradley-Terry + Elo 评分系统

使用统计学 Bradley-Terry 模型分析成对比较数据 转换为类国际象棋 Elo 等级分,直观展示模型相对实力 显示置信区间(误差条),样本量<300的模型会被排除

🌍 多维度竞技场

Text Arena: 文本对话综合能力 Vision Arena: 图像理解能力 Text-to-Video Arena: 视频生成能力 Coding Arena: 编程专项能力 Hard Prompts: 复杂提示词处理 Math/Instruction Following: 数学与指令遵循

平台特色

实时动态排名

排行榜随新投票实时更新,反映最新模型表现 支持按时间段筛选(月度、季度、历史最佳)

模型全覆盖

闭源商业模型:GPT-4o、Claude-3.5、Gemini-2.0、Grok-3 开源模型:Llama-3、Qwen2.5、DeepSeek-V3、Mistral 支持模型版本细分(如 gpt-4o-2024-08-06 vs latest)

数据透明开放

公开所有投票数据集(Conversation Dataset) 提供 API 和 FastChat 开源代码 支持研究人员下载数据复现分析

使用方法

盲测对战: 访问 lmarena.ai,输入任意提示词,与两个匿名模型对话并投票 指定对战: 选择特定模型进行 head-to-head 对比 查看榜单: 浏览实时排行榜,查看各模型 Elo 分数和置信区间 分类筛选: 按数学、编程、长文本等维度查看专项排名

近期榜单亮点(2025年数据)

| 排名 | 模型 | Elo 分数 | 特点 |

|---|---|---|---|

| #1 | GPT-4o-latest | ~1314 | 编程、指令遵循、多轮对话全第一 |

| #2 | Gemini-2.0-flash-thinking | ~1297 | Google 最强模型,首次登顶后回落 |

| #3 | Claude-3.5-Sonnet | ~1270 | 安全性与长文本处理优异 |

| #7 | Qwen2.5-Max | ~1332 | 数学编程专项第一,开源模型最佳 |

| Top | DeepSeek-R1 | ~1280 | 推理能力突出,性价比极高 |

学术认可与影响

论文引用: 平台方法论论文《Chatbot Arena: An Open Platform for Evaluating LLMs by Pairwise Comparison》已被广泛引用 行业标准: 被 OpenAI、Google、Anthropic 等顶级实验室作为模型发布的重要参考指标 竞赛平台: 举办 WSDM Cup 2025 多语言自动评估模型竞赛,奖金池 $50,000 社区生态: 衍生出意大利语版 Chatbot Arena Italia 等本地化版本

局限性与注意事项

⚠️ 评估偏差

用户群体偏向技术爱好者,可能与大众偏好存在差异 提示词分布偏向日常对话,专业领域(如法律、医疗)覆盖不足

⚠️ 博弈风险

存在厂商针对榜单优化模型的"应试教育"现象(Goodhart's Law) 部分闭源模型 API 版本可能动态更新,难以保证测试一致性

⚠️ 安全与伦理

对战模式可能暴露模型安全漏洞(越狱提示) 平台实施异常用户检测,但反作弊细节未完全公开

同类对比

| 特性 | LMSYS Arena | MMLU | HELM | HuggingFace Leaderboard |

|---|---|---|---|---|

| 评估方式 | 人类主观偏好 | 客观题自动评分 | 多维度场景测试 | 自动化基准测试 |

| 实时性 | 实时更新 | 静态数据集 | 定期更新 | 定期更新 |

| 偏见控制 | 双盲匿名 | 无 | 透明提示 | 无 |

| 成本 | 免费(众包) | 免费 | 免费 | 免费 |

| 适用场景 | 对话体验选型 | 知识能力评估 | 安全/鲁棒性评估 | 开源模型对比 |

适合人群

AI 研究者: 获取真实人类偏好数据,验证模型对齐效果 开发者选型: 在部署前对比不同模型在实际场景中的表现 普通用户: 免费体验顶级模型(GPT-4、Claude 等)的匿名版本 模型厂商: 获得第三方公正评估,指导模型迭代方向

一句话价值: 在 AI 模型选择困难的今天,LMSYS Chatbot Arena 提供了由真实人类投票产生的"民意排行榜",是衡量模型实用对话能力的最权威第三方基准。