正文内容

LM Studio 是一款免费的跨平台桌面软件,允许用户在 Windows、macOS 和 Linux 上本地运行开源大语言模型。它提供直观的图形界面用于模型发现、下载和对话,支持 GGUF 和 MLX 格式,内置 API 服务器兼容 OpenAI 协议,并支持 RAG 文档问答。所有数据本地处理,无需联网,适合注重隐私的用户和 AI 初学者。

LM Studio 核心特性

🖥️ 优雅的图形化界面

无需命令行,通过可视化界面搜索、下载、加载模型 内置 Hugging Face 集成,直接搜索社区模型(Llama、Mistral、Gemma、Qwen、DeepSeek 等) 实时显示 token 生成速度、内存占用等性能指标

🔒 完全的本地隐私

所有对话数据保存在本地,不上传云端 支持完全离线运行,无需网络连接 不收集任何用户数据,代码开源可审计

⚡ 双引擎推理支持

GGUF 格式: 基于 llama.cpp,支持跨平台(Windows/Linux/macOS),兼容 Q2_K 到 Q8_0 等多种量化级别 MLX 格式: Apple Silicon 专属优化(M1/M2/M3/M4),利用 Metal GPU 加速,在 Mac 上比 GGUF 快 40-50%

🤖 多模型管理与对比

同时加载多个模型,进行 A/B 对比测试 支持多聊天窗口,不同模型并行对话 模型版本管理,轻松切换不同量化版本

📄 RAG 文档问答

本地文档嵌入,支持 PDF、TXT 等格式 基于检索增强生成(RAG),针对文档内容提问 所有文档处理本地完成,保护敏感信息

🔌 本地 API 服务器

提供 OpenAI 兼容的 REST API( http://localhost:1234/v1)支持第三方应用集成(如 Obsidian、VS Code 插件) 命令行工具 lms支持脚本化操作

支持的模型

热门开源模型:

Meta: Llama 3.3、Llama 3.2、Llama 3.1(1B 到 405B 参数) 阿里巴巴: Qwen 2.5、Qwen 3、Qwen-VL(多模态) Google: Gemma 3、Gemma 2 DeepSeek: DeepSeek-V3、DeepSeek-R1(推理模型) OpenAI: gpt-oss-20b、gpt-oss-120b Mistral: Mistral 7B、Mixtral 8x7B Microsoft: Phi-4、Phi-3

模型格式支持:

GGUF(通用跨平台格式,适合所有设备) MLX(Apple Silicon 优化格式,Mac 首选)

LM Studio 硬件要求

| 配置 | 最低要求 | 推荐配置 |

|---|---|---|

| Mac | M1 芯片 + 8GB 统一内存 | M2/M3/M4 + 16GB 内存 |

| Windows | 支持 AVX2 的 CPU + 8GB RAM | NVIDIA/AMD 独显 + 16GB RAM |

| Linux | 支持 AVX2 的 CPU + 8GB RAM | CUDA 显卡 + 16GB RAM |

| 存储 | 10GB 可用空间 | 50GB+ SSD(模型文件较大) |

显存参考:

6GB 以下:适合 1.5B-3B 参数模型(Q4_K_M 量化) 8GB-12GB:可运行 7B-14B 参数模型 12GB 以上:支持 33B-70B 参数模型(Q8_量化)

LM Studio 安装与使用

下载安装:

访问 https://lmstudio.ai/ 下载对应平台安装包 Windows 安装 .exe,macOS 拖拽至应用程序,Linux 使用 AppImage

快速开始:

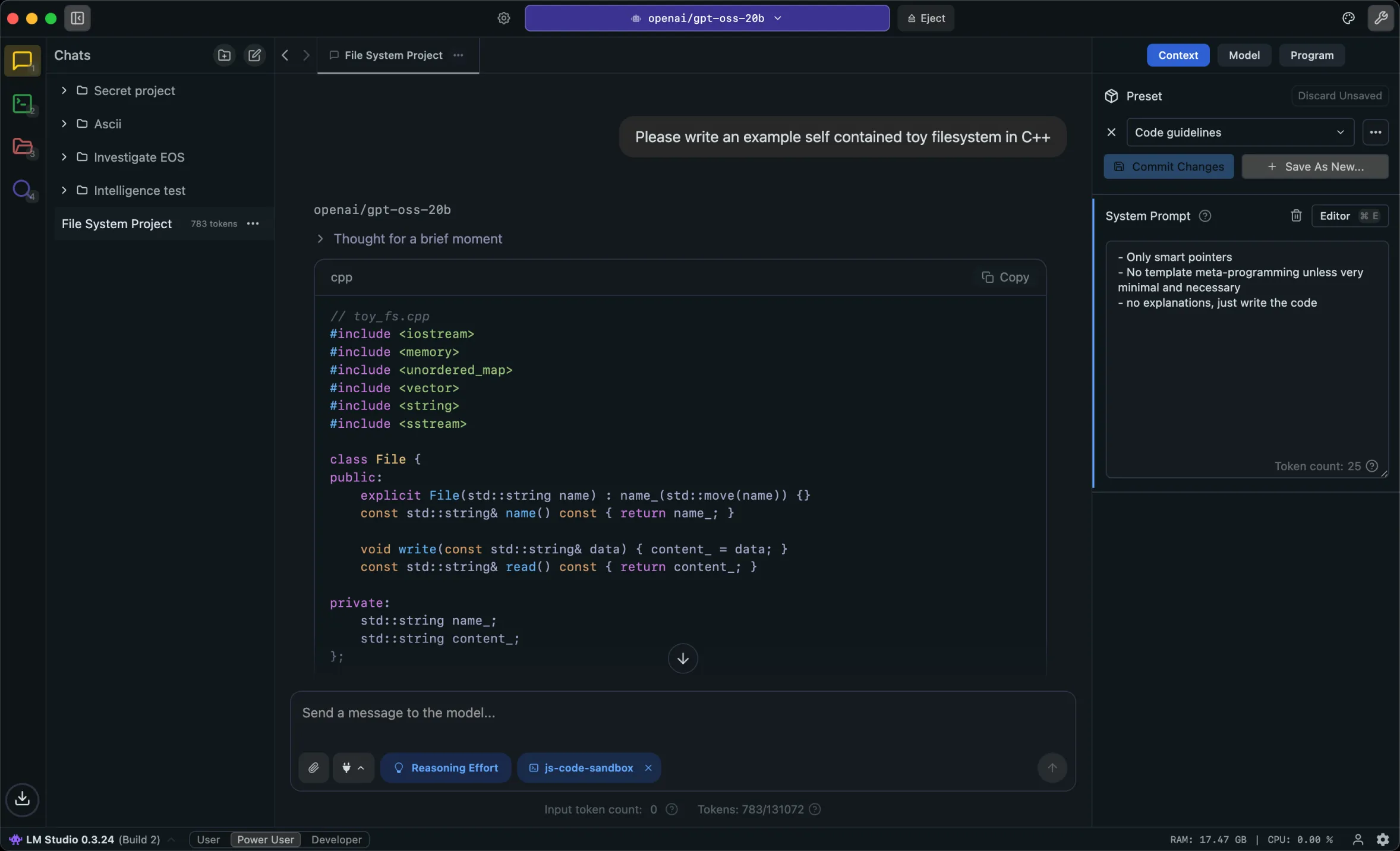

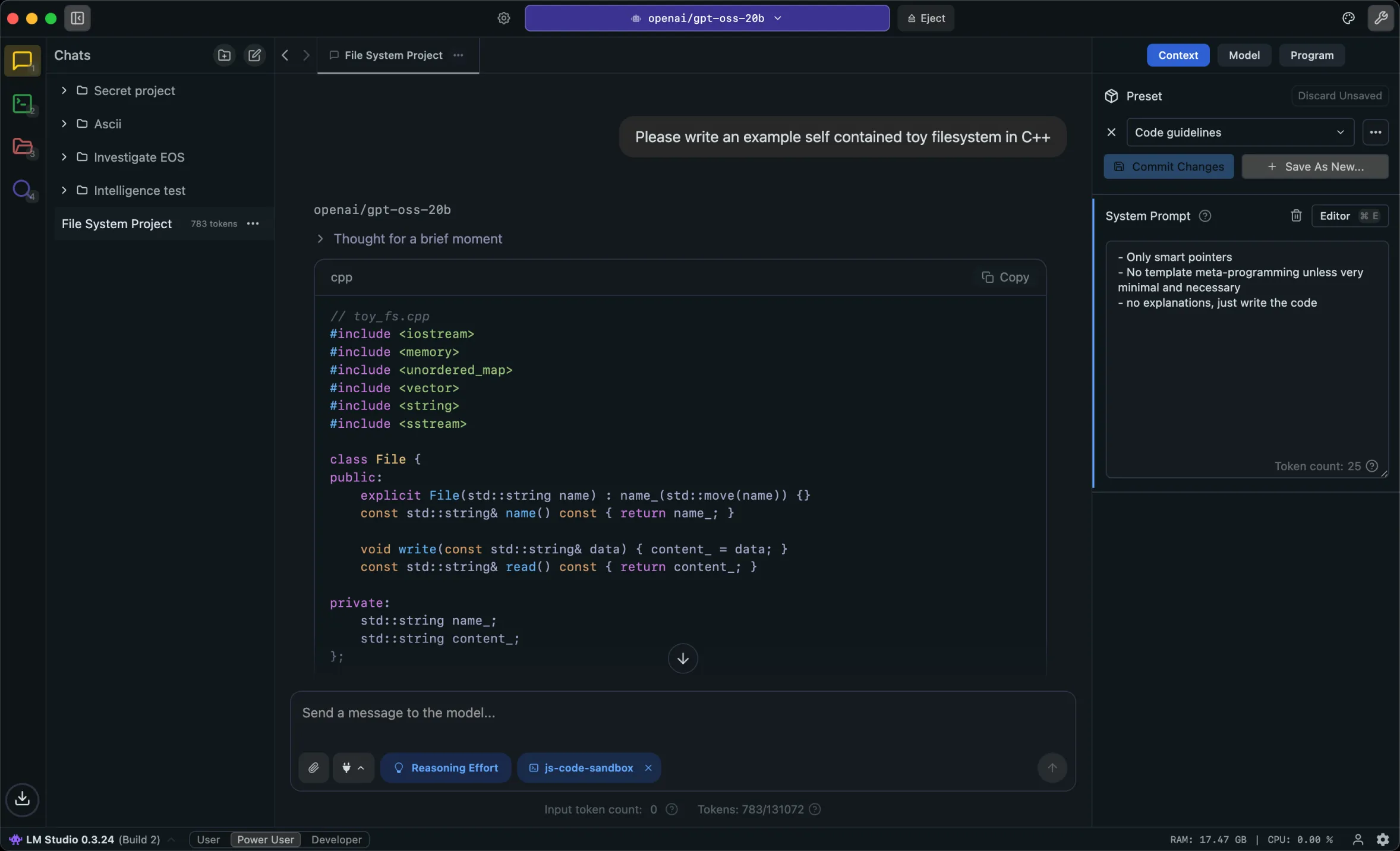

打开软件,在搜索栏输入模型名称(如 "Qwen 2.5") 选择适合的量化版本(Q4_K_M 为平衡选择) 点击下载,完成后在 Chat 界面加载模型 开始对话,右侧可调整 Temperature、Max Tokens 等参数

命令行工具:

# 安装 LM Studio CLI

lms get openai/gpt-oss-20b

lms load openai/gpt-oss-20b

lms chat openai/gpt-oss-20b实际应用场景

隐私优先的 AI 助手

处理敏感文档(合同、医疗记录)时完全本地运行,避免数据泄露风险 企业内网环境离线使用,符合数据合规要求

模型评估与选型

在产品集成前,通过 LM Studio 快速测试不同模型的回答质量 对比同一模型的不同量化版本,找到性能与质量的最佳平衡点

开发测试环境

通过本地 API 服务器为开发应用提供 LLM 能力,无需消耗云 API 额度 测试 RAG 应用时,本地快速迭代文档嵌入策略

教育学习

学生和教育工作者免费使用顶级开源模型,无需订阅费用 学习提示词工程(Prompt Engineering)和模型参数调优

同类工具对比

| 特性 | LM Studio | Ollama | Jan | GPT4All |

|---|---|---|---|---|

| 界面类型 | 图形界面为主 | 命令行为主 | 图形界面 | 图形界面 |

| 易用性 | ⭐⭐⭐⭐⭐(最佳) | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Mac 优化 | ⭐⭐⭐⭐⭐(MLX 支持) | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

| API 支持 | ✅ OpenAI 兼容 | ✅ OpenAI 兼容 | ✅ | ✅ |

| RAG 支持 | ✅ 内置 | ❌ 需配合其他工具 | ✅ | ✅ |

| 模型发现 | ✅ HuggingFace 集成 | ❌ 需手动下载 | ✅ | ✅ |

| 多模型对比 | ✅ 同时加载 | ❌ | ✅ | ❌ |

| 适合人群 | 初学者/评测者 | 开发者 | 隐私用户 | 轻度用户 |

优势与局限

✅ 核心优势:

最佳入门体验: 2025 年本地 LLM 工具中最友好的图形界面,无需技术背景 Apple Silicon 优化: 通过 MLX 引擎在 Mac 上实现业界领先的推理速度 零数据收集: 真正的隐私优先设计,断网可用 模型生态丰富: 直接接入 Hugging Face 海量模型库

⚠️ 注意事项:

硬件门槛: 运行 70B 参数以上大模型仍需高端显卡(24GB+ VRAM) 功能定位: 侧重个人使用,企业级功能(如多用户管理、审计日志)有限 商业授权: 个人免费,企业使用需联系官方获取授权

开发者生态

CLI 工具: 提供 lms命令行工具,支持自动化脚本API 兼容: REST API 与 OpenAI SDK 兼容,易于迁移现有应用 自定义模型: 支持加载本地 GGUF/MLX 文件,微调模型导入

适合人群

AI 初学者: 第一次接触本地 LLM,想要图形化工具降低门槛 隐私敏感用户: 拒绝将个人数据上传到云端,需要完全本地化的 AI 助手 模型研究者: 需要快速对比测试多个开源模型的实际表现 Mac 用户: 拥有 Apple Silicon 设备,希望充分发挥 M 系列芯片性能

LM Studio 是目前最易用的本地大模型管理工具,它将 Hugging Face 的海量模型资源包装在优雅的图形界面中,让任何人都能在几分钟内在自己的电脑上部署私有 AI 助手,且完全免费。